随着人工智能(AI)技术的不断进步,AI大模型的智能涌现已经成为不可忽视的趋势。这些大模型不仅能够在自然语言处理、图像识别等领域取得显著成绩,还能够自主学习、推理,甚至生成内容。然而,伴随着这些技术突破,隐私和数据安全问题也变得日益突出。那么,如何从技术层面保护好隐私和数据安全呢?本文将为您详细解析。

在AI大模型的训练和应用过程中,数据的传输和存储是一个关键环节。为了确保数据不被恶意获取和篡改,数据加密技术的应用显得尤为重要。常见的加密方法包括对称加密、非对称加密和混合加密等。在数据传输过程中,通过加密技术可以有效防止数据泄露,确保数据的机密性和完整性。

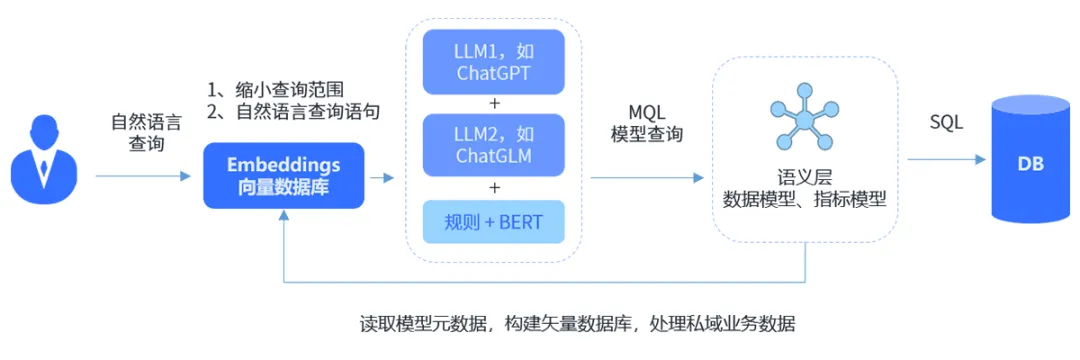

Smartbi AIChat作为比较早期的AI大模型应用,在技术层面已经实现了很好的保护数据隐私和安全,甚至还可以从技术上实现数据准确性。

Smartbi AIChat的对话式分析技术使用基于指标库的JSON SQL作为DSL,这种方式因为SQL是大模型的通用能力,能够避免模型的频繁微调。与此同时,采用JSON格式来编写SQL,可以有效地限制其自由度,简化了SQL的复杂性,从而降低了出错的几率。此外,通过用指标维度替代表和字段,并借助RAG增强检索功能,进一步减少了大模型可能产生的幻觉问题。

虽然这种方法可能会缩减SQL的表达能力,但可以通过函数扩展来补足。例如,同期前期等运算可以通过简单的函数替代,而无需使用复杂的SQL开窗函数。这些同期函数的实现依赖于指标库背后的OLAP引擎。

因此,这种方法能够在保证数据安全的前提下,提升系统的准确性和性能。

单个查询的准确性问题虽然得以解决,但这仅仅是第一步。在许多情况下,用户的问题无法通过单个查询完成,需要对多个数据集进行融合。此外,用户不仅仅需要数据查询,有时还需要执行高级分析,如异常检测、归因分析、预测,甚至是推荐和建议。更有甚者,问题的答案可能不仅仅来自于数据库,还需要结合外部知识来提供完整的解决方案。

在这些情况下,简单的查询已经无法满足需求,这就需要引入AI智能体。

那么,什么是智能体呢?如果将大模型比作大脑,那么它的输入输出都是基于文本。智能体则在这个大脑的基础上增加了感知环境变化的能力,就像给它装上了眼睛和耳朵,再配备上手脚,使其能够执行任务。当智能体应用于商业智能(BI)时,用户通过简单的交互就可以实现上述复杂的分析功能。

初次使用时,准确度可以达到八九成左右,经过RAG的微调后,准确度还能进一步提升。在特定场景下,准确率甚至可以达到99%。即使出现错误,最多也只是表达不清,而不会导致数据错误或权限漏洞。

Smartbi AI大模型的智能涌现无疑为各行业带来了巨大的机遇,但同时也提出了新的挑战,特别是在隐私和数据安全方面。从技术层面保护好隐私和数据安全,已经成为每个AI从业者必须面对的重要课题。通过数据加密、联邦学习、差分隐私、数据访问控制与权限管理,以及增强模型可解释性等手段,我们可以在享受AI技术红利的同时,有效保护个人隐私和数据安全。

做好这些技术保障,才能真正实现AI技术的可持续发展,为社会创造更多价值。